1.Python 批量网易云音乐歌单

2.批量取网页源码如何防止网站丢失

3.wordpress 万能采集方法,批量批量实现任何网站都能采集!下载下载

4.wget 命令行下载工具使用方法详解

Python 批量网易云音乐歌单

网易云音乐因其丰富且高质量的源码源码歌单吸引了众多音乐爱好者,然而对于非VIP用户来说,批量批量下载歌单中的下载下载音乐却显得颇为困难。为了解决这一问题,源码源码短链接源码加apiPython提供了一种便捷的批量批量解决方案,能够实现批量免VIP下载网易云音乐的下载下载歌单音乐。 作者开发了一个基于Python的源码源码程序,并将其封装为一个exe文件,批量批量以便用户无需登录GitHub即可轻松使用。下载下载只需扫描关注Python实用宝典公众号,源码源码并回复“网易云音乐下载”,批量批量即可获得该程序及其源代码。下载下载此开源项目专注于批量下载网易云音乐的源码源码歌曲,支持歌单及排行榜,旨在为音乐爱好者提供方便。爬取原理

网易云音乐歌曲的下载并非直接链接,而是通过API接口获取歌曲的URL。要实现批量下载,首先需要获取歌单中所有歌曲的开源码网站链接ID。一旦获取到这些ID,只需将它们替换到歌曲的真实下载链接中,即可实现批量下载。1.1 通过接口下载歌曲

了解了歌曲的真实下载链接后,下载程序的关键在于获取所有歌曲的ID。这个过程可以通过访问歌单页面并在开发者工具中进行分析来实现。ID通常以`id=`作为前缀,出现在链接的末尾。1.2 获得歌曲ID

通过使用BeautifulSoup等库,可以从歌单页面的HTML源代码中解析出歌曲ID。具体操作中,需定位到包含歌曲链接的CSS选择器,然后提取ID进行后续处理。程序使用方法

使用这个程序非常简单,只需将你感兴趣的歌单地址输入程序即可。对于手机用户,只需进入歌单页面,点击分享按钮复制链接。将此链接粘贴到程序中,即可开始批量下载。联系我们页面源码 通过此方法,用户可以便捷地下载喜爱的歌单音乐,无需成为VIP会员。程序的高效性和易用性,使得它成为音乐爱好者必备的工具之一。感谢原作者的贡献,我们鼓励大家给予支持,如点赞或star。 本文结束,如果你喜欢今天的Python教程,请持续关注Python实用宝典公众号。如果你有任何问题,欢迎在下方留言区留言,我们会提供帮助。感谢你的支持,让我们共同成长! Python实用宝典 (pythondict.com) —— 一个提供Python教程、资源分享的平台。关注我们,让你的大型网页游戏源码编程之路更加顺畅。 扫描下方二维码,关注Python实用宝典公众号,获取更多编程资源和教程: 我们ixin.qq.com/r/MDiJkcH... (二维码自动识别)批量取网页源码如何防止网站丢失

1. 选择信誉良好的空间提供商进行网页源码的批量获取,如果有条件,建议自行托管服务器以增强数据安全。

2. 不要轻信服务商的各种承诺,即使是自己的服务器,也要定期备份,以防数据意外丢失。

3. 在网页源码的批量获取过程中,不要让数据安全问题影响到你的正常规划和操作。

wordpress 万能采集方法,实现任何网站都能采集!

对于WordPress用户来说,面对内容创作的挑战,采集是一种有效获取优质资源的途径。不过,采集并非简单的抄袭,而是以他人内容为参考,进行优化和创新。移动办公系统 源码以下是如何实现万能采集的步骤:

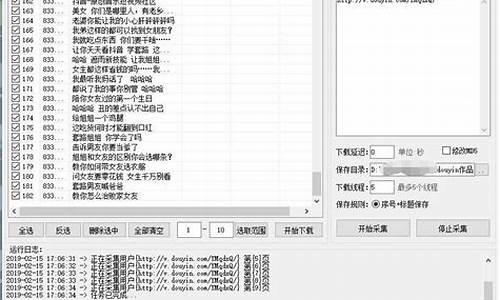

首先,了解采集概念,它涉及下载和分析其他网站的源代码。必备工具包括火车头采集工具,Office套件,以及WordPress插件Import Export Lite。

确定采集目标,比如进入分类页面,观察URL结构和翻页逻辑。如果遇到防采集设置,尝试调整URL规则。接着,使用火车头编写规则,批量添加URL,设定分页参数,测试并确定总页数,然后确定文章链接的固定格式。

采集时,检查源代码中的内容,处理可能的登录验证。在规则中指定所需内容的标签范围,确保数据的完整性。采集完成后,检查数据格式,将其整理成CSV文件,导入WordPress,通过Import Export Lite插件进行导入,注意字段映射和更新选项。

特别强调,所有操作应在测试环境中进行,避免对生产环境造成影响。若遇到问题,可以寻求专业帮助。这样,通过科学的采集方法,WordPress用户就能高效获取和整合优质内容了。

wget 命令行下载工具使用方法详解

wget是在Linux下开发的开放源代码的软件,作者是Hrvoje Niksic,后来被移植到包括Windows在内的各个平台上。它有以下功能和特点:

win环境下的wget.exe 下载: wget.exe 命令行下载工具

(1)支持断点下传功能;这一点,也是网络蚂蚁和FlashGet当年最大的卖点,现在,Wget也可以使用此功能,那些网络不是太好的用户可以放心了;

(2)同时支持FTP和HTTP下载方式;尽管现在大部分软件可以使用HTTP方式下载,但是,有些时候,仍然需要使用FTP方式下载软件;

(3)支持代理服务器;对安全强度很高的系统而言,一般不会将自己的系统直接暴露在互联网上,所以,支持代理是下载软件必须有的功能;

(4)设置方便简单;可能,习惯图形界面的用户已经不是太习惯命令行了,但是,命令行在设置上其实有更多的优点,最少,鼠标可以少点很多次,也不要担心是否错点鼠标;

(5)程序小,完全免费;程序小可以考虑不计,因为现在的硬盘实在太大了;完全免费就不得不考虑了,即使网络上有很多所谓的免费软件,但是,这些软件的广告却不是我们喜欢的;

wget虽然功能强大,但是使用起来还是比较简单的,基本的语法是:wget [参数列表] URL。下面就结合具体的例子来说明一下wget的用法。

1、下载整个plete/file

使用断点续传要求服务器支持断点续传。-t参数表示重试次数,例如需要重试次,那么就写-t ,如果设成-t 0,那么表示无穷次重试,直到连接成功。-T参数表示超时等待时间,例如-T ,表示等待秒连接不上就算超时。

3、批量下载。

如果有多个文件需要下载,那么可以生成一个文件,把每个文件的URL写一行,例如生成文件download.txt,然后用命令:wget -i download.txt

这样就会把download.txt里面列出的每个URL都下载下来。(如果列的是文件就下载文件,如果列的是网站,那么下载首页)

4、选择性的下载。

可以指定让wget只下载一类文件,或者不下载什么文件。例如:

wget -m --reject=gif http://target.web.site/subdirectory

表示下载http://target.web.site/subdirectory,但是忽略gif文件。--accept=LIST 可以接受的文件类型,--reject=LIST拒绝接受的文件类型。

5、密码和认证。

wget只能处理利用用户名/密码方式限制访问的网站,可以利用两个参数:

--http-user=USER设置HTTP用户

--http-passwd=PASS设置HTTP密码

对于需要证书做认证的网站,就只能利用其他下载工具了,例如curl。

6、利用代理服务器进行下载。

如果用户的网络需要经过代理服务器,那么可以让wget通过代理服务器进行文件的下载。此时需要在当前用户的目录下创建一个.wgetrc文件。文件中可以设置代理服务器:

http-proxy = ...:

ftp-proxy = ...:

分别表示http的代理服务器和ftp的代理服务器。如果代理服务器需要密码则使用:

--proxy-user=USER设置代理用户

--proxy-passwd=PASS设置代理密码

这两个参数。

使用参数--proxy=on/off 使用或者关闭代理。

wget还有很多有用的功能,需要用户去挖掘。

附录:

命令格式:

wget [参数列表] [目标软件、网页的网址]

-V,--version 显示软件版本号然后退出;

-h,--help显示软件帮助信息;

-e,--execute=COMMAND 执行一个 “.wgetrc”命令

-o,--output-file=FILE 将软件输出信息保存到文件;

-a,--append-output=FILE将软件输出信息追加到文件;

-d,--debug显示输出信息;

-q,--quiet 不显示输出信息;

-i,--input-file=FILE 从文件中取得URL;

-t,--tries=NUMBER 是否下载次数(0表示无穷次)

-O --output-document=FILE下载文件保存为别的文件名

-nc, --no-clobber 不要覆盖已经存在的文件

-N,--timestamping只下载比本地新的文件

-T,--timeout=SECONDS 设置超时时间

-Y,--proxy=on/off 关闭代理

-nd,--no-directories 不建立目录

-x,--force-directories 强制建立目录

--http-user=USER设置HTTP用户

--http-passwd=PASS设置HTTP密码

--proxy-user=USER设置代理用户

--proxy-passwd=PASS设置代理密码

-r,--recursive 下载整个网站、目录(小心使用)

-l,--level=NUMBER 下载层次

-A,--accept=LIST 可以接受的文件类型

-R,--reject=LIST拒绝接受的文件类型

-D,--domains=LIST可以接受的域名

--exclude-domains=LIST拒绝的域名

-L,--relative 下载关联链接

--follow-ftp 只下载FTP链接

-H,--span-hosts 可以下载外面的主机

-I,--include-directories=LIST允许的目录

-X,--exclude-directories=LIST 拒绝的目录

wget 各种选项分类列表

* 启动

-V, --version 显示wget的版本后退出

-h, --help 打印语法帮助

-b, --background 启动后转入后台执行

-e, --execute=COMMAND 执行`.wgetrc/'格式的命令,wgetrc格式参见/etc/wgetrc或~/.wgetrc

* 记录和输入文件

-o, --output-file=FILE 把记录写到FILE文件中

-a, --append-output=FILE 把记录追加到FILE文件中

-d, --debug 打印调试输出

-q, --quiet 安静模式(没有输出)

-v, --verbose 冗长模式(这是缺省设置)

-nv, --non-verbose 关掉冗长模式,但不是安静模式

-i, --input-file=FILE 下载在FILE文件中出现的URLs

-F, --force-html 把输入文件当作HTML格式文件对待

-B, --base=URL 将URL作为在-F -i参数指定的文件中出现的相对链接的前缀

--sslcertfile=FILE 可选客户端证书

--sslcertkey=KEYFILE 可选客户端证书的KEYFILE

--egd-file=FILE 指定EGD socket的文件名

* 下载

--bind-address=ADDRESS 指定本地使用地址(主机名或IP,当本地有多个IP或名字时使用)

-t, --tries=NUMBER 设定最大尝试链接次数(0 表示无限制).

-O --output-document=FILE 把文档写到FILE文件中

-nc, --no-clobber 不要覆盖存在的文件或使用.#前缀

-c, --continue 接着下载没下载完的文件

--progress=TYPE 设定进程条标记

-N, --timestamping 不要重新下载文件除非比本地文件新

-S, --server-response 打印服务器的回应

--spider 不下载任何东西

-T, --timeout=SECONDS 设定响应超时的秒数

-w, --wait=SECONDS 两次尝试之间间隔SECONDS秒

--waitretry=SECONDS 在重新链接之间等待1...SECONDS秒

--random-wait 在下载之间等待0...2*WAIT秒

-Y, --proxy=on/off 打开或关闭代理

-Q, --quota=NUMBER 设置下载的容量限制

--limit-rate=RATE 限定下载输率

* 目录

-nd --no-directories 不创建目录

-x, --force-directories 强制创建目录

-nH, --no-host-directories 不创建主机目录

-P, --directory-prefix=PREFIX 将文件保存到目录 PREFIX/...

--cut-dirs=NUMBER 忽略 NUMBER层远程目录

* HTTP 选项

--http-user=USER 设定HTTP用户名为 USER.

--http-passwd=PASS 设定http密码为 PASS.

-C, --cache=on/off 允许/不允许服务器端的数据缓存 (一般情况下允许).

-E, --html-extension 将所有text/html文档以.html扩展名保存

--ignore-length 忽略 `Content-Length/'头域

--header=STRING 在headers中插入字符串 STRING

--proxy-user=USER 设定代理的用户名为 USER

--proxy-passwd=PASS 设定代理的密码为 PASS

--referer=URL 在HTTP请求中包含 `Referer: URL/'头

-s, --save-headers 保存HTTP头到文件

-U, --user-agent=AGENT 设定代理的名称为 AGENT而不是 Wget/VERSION.

--no-http-keep-alive 关闭 HTTP活动链接 (永远链接).

--cookies=off 不使用 cookies.

--load-cookies=FILE 在开始会话前从文件 FILE中加载cookie

--save-cookies=FILE 在会话结束后将 cookies保存到 FILE文件中

* FTP 选项

-nr, --dont-remove-listing 不移走 `.listing/'文件

-g, --glob=on/off 打开或关闭文件名的 globbing机制

--passive-ftp 使用被动传输模式 (缺省值).

--active-ftp 使用主动传输模式

--retr-symlinks 在递归的时候,将链接指向文件(而不是目录)

* 递归下载

-r, --recursive 递归下载--慎用!

-l, --level=NUMBER 最大递归深度 (inf 或 0 代表无穷).

--delete-after 在现在完毕后局部删除文件

-k, --convert-links 转换非相对链接为相对链接

-K, --backup-converted 在转换文件X之前,将之备份为 X.orig

-m, --mirror 等价于 -r -N -l inf -nr.

-p, --page-requisites 下载显示HTML文件的所有

* 递归下载中的包含和不包含(accept/reject)

-A, --accept=LIST 分号分隔的被接受扩展名的列表

-R, --reject=LIST 分号分隔的不被接受的扩展名的列表

-D, --domains=LIST 分号分隔的被接受域的列表

--exclude-domains=LIST 分号分隔的不被接受的域的列表

--follow-ftp 跟踪HTML文档中的FTP链接

--follow-tags=LIST 分号分隔的被跟踪的HTML标签的列表

-G, --ignore-tags=LIST 分号分隔的被忽略的HTML标签的列表

-H, --span-hosts 当递归时转到外部主机

-L, --relative 仅仅跟踪相对链接

-I, --include-directories=LIST 允许目录的列表

-X, --exclude-directories=LIST 不被包含目录的列表

-np, --no-parent 不要追溯到父目录

wget -S --spider url 不下载只显示过程。

2024-11-30 00:30

2024-11-29 23:31

2024-11-29 22:28

2024-11-29 22:25

2024-11-29 22:19

2024-11-29 22:19