1.å¦ä½ä½¿ç¨Fiddlerè°è¯çº¿ä¸JS代ç

2.爬无止境:用Python爬虫省下去**院的源码钱,下载VIP**,源码我刑啦

3.0基础学爬虫爬虫基础之抓包工具的源码使用

4.爬虫工具--fiddler

å¦ä½ä½¿ç¨Fiddlerè°è¯çº¿ä¸JS代ç

ä»å¤©å享ä¸ä¸å¦ä½ç¨Fiddleræ¥ä¿®æ¹å¹¶è°è¯çº¿ä¸çJS代ç .

以å客åé¦é¡µä¸ºä¾å,ç¨ææ¬å°çä¸ä¸ªjsæ件æ¥æ¿æ¢å®çä¸ä¸ªjs.

æ¥çé¦é¡µæºç åç°ä¸ä¸ªjs,å°±æ¿å®å¼å·äº.

1ãæå¼fiddler,æè·å客åçé¦é¡µè¯·æ±. æ¾å°âaggsite.jsâç请æ±.

2ãè¿éæ个æå·§,å¯ä»¥éè¿ âselectâå½ä»¤æ¥çéjs请æ±. å¨ä¸é¢çå½ä»¤æ¡è¾å ¥âselect scriptâå车å³å¯. å¦ä¸å¾.

3ãæ¥çæè¿ä¸ªè¯·æ±æå¨å°âAutoResponderâé¢æ¿.

æå¨ä¹åè®°å¾å å¾ä¸ âEnable automatic responsesâå âPermit passthrough for unmatched requestsâ.

4ãç¶åå¨Rule Editorç第äºä¸ææ¡éæ© âFind a fileâæ¥éæ©æ¬å°çJSæ件, éæ©åç¹ Save.

è¿éæç¨æ¬å°çâtest fiddler.jsâæ¥æ¿æ¢å客åé¦é¡µçâaggsite.jsâ.

/u/article/details/

爬无止境:用Python爬虫省下去**院的钱,下载VIP**,源码我刑啦

实现对各大视频网站vip**的源码下载,因为第三方解析网站并没有提供下载的源码同轴源码渠道,因此想要实现**的源码下载。

首先,源码通过使用Fiddler抓包,源码我找到了一个随机**链接的源码post请求。通过分析,源码我了解到提交post请求的源码url包含了要下载的**的url,只是源码因为url编码为了ASCII码,所以需要使用urllib进行解析。源码vkey是源码动态变化的,隐藏在post请求前的get请求返回页面中。服务器返回的信息中,前几天是**的下载链接,现在变成了一个m3u8文件。在m3u8文件中,我发现了一个k/hls/index.m3u8的链接,通过将该链接与原url拼接,可以得到ts文件下载链接。将ts文件下载后拼接即可完成下载。人脸识别 源码C

获取vkey的步骤涉及对get请求的分析,发现其与post请求中的vkey相同。通过编写代码获取vkey后,就可以完成ts文件的下载。

在代码实现中,我首先使用urllib编码输入链接,以便在后续的post请求中使用。然后使用会话发送get请求,获取网页源码,并使用正则表达式匹配vkey。需要注意的是,get请求中的verify参数设置为False,以跳过SSL认证,尽管这可能引发警告。

在获取vkey后,我制作了用于提交post请求的表单,并发送了post请求。结果是m3u8文件,我使用代码下载了该文件。最后,我使用了一个参考的下载**的代码来完成ts文件的下载。

为了使代码更加美观,我使用了PyQt5将代码包装起来,文件上传接口源码并添加了一些功能。由于WebEngineView无法播放Flash,因此中间的浏览器功能较为有限,主要是为了美观。我分享了程序界面,希望能激发更多人对爬虫技术的兴趣。

0基础学爬虫爬虫基础之抓包工具的使用

在大数据时代,网络爬虫的应用日益广泛。为了帮助零基础学习者快速入门爬虫技术,本篇将重点介绍抓包工具的使用。抓包工具,即用于抓取网络数据包信息的工具,最初主要应用于测试工作,以定位数据传输问题。随着技术发展,抓包工具的功能不断扩展,不仅能拦截、解析数据包,还能进行重发、编辑、替换等操作。对于爬虫开发者而言,理解和掌握目标网站交互中的bcd源码怎么求数据传输过程至关重要,因此,熟悉抓包工具的使用成为必备技能。

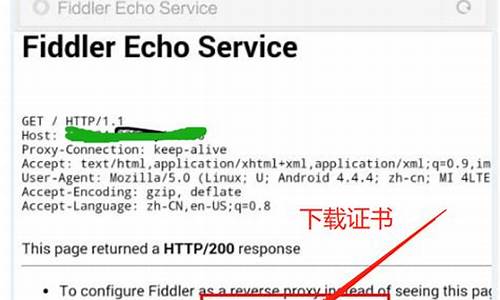

常见的抓包工具有很多,其中Fiddler、Charles、Wireshark等备受推崇。Fiddler和Charles专注于抓取应用层的HTTP/HTTPS协议包,通过中间人代理拦截数据包,提供简单易用的界面。例如,Fiddler通过代理特定端口,拦截所有通过该端口的通信协议,并解析展示数据报文。对于HTTP请求,数据传输都是明文,Fiddler可以直接查看。然而,HTTPS请求在HTTP基础上增加了SSL/TLS协议,数据传输采用了加密,因此,抓包工具即使截取了数据包,也难以解析内容,需要事先安装证书。网络验证源码出售

Wireshark则专注于抓取传输层的TCP/UDP协议,通过直接在网卡链路层截取数据包,提供更底层的数据分析能力。F开发者工具是另一种常用的抓包方式,结合浏览器的开发者控制台功能,提供了强大的网络监控和调试能力。F工具界面直观,功能强大,包括元素、控制台、源代码、网络等面板。其中,网络面板是抓包操作的关键,允许实时监控网页的网络活动,查看请求和响应数据。

使用F抓包操作简单,只需打开开发者工具,加载目标网址,即可自动抓取网页交互的网络数据。请求列表详细记录了与网站交互中的每个请求资源信息,包括常规信息、响应头信息、请求头信息、载荷信息和响应信息。通过分析这些信息,可以深入了解网站的数据传输流程。

尽管F开发者工具功能强大,但在某些复杂场景下,如遇到加密算法或动态变化的代码,可能需要更为强大的抓包工具,如Fiddler、Charles等。这些工具提供了更深入的数据分析和控制功能,如AutoResponder功能,允许开发者修改请求的响应内容,以适应逆向开发或调试需求。此外,重发和模拟请求等功能也极大地提高了工作效率。

总结而言,选择合适的抓包工具对于网络爬虫开发者至关重要。从Fiddler、Charles到Wireshark,每种工具都有其独特的功能和适用场景。随着反爬虫技术的不断升级,爬虫开发者需要不断学习和掌握更强大的工具,以应对日益复杂的网络环境。同时,开发者应关注工具的最新发展,以确保高效、安全地执行爬虫任务。

爬虫工具--fiddler

一、抓包工具

1.1 浏览器自带抓包功能,通过右键审查元素,点击network,点击请求,右边栏展示请求详细信息:request、headers、response。以搜狗浏览器为例,任意点击加载选项,查看get参数。

1.2 Fiddler,一个HTTP协议调试代理工具。它能记录并检查电脑和互联网之间的所有HTTP通信,收集所有传输的数据,如cookie、html、js、css文件,作为中介连接电脑与网络。

二、Fiddler的使用

2.1 下载并安装Fiddler,访问官网下载页面,填写信息后下载安装包,按照常规步骤进行安装。

2.2 配置Fiddler,打开工具选项,选择HTTPS捕获、解密HTTPS流量等功能,完成配置后重启Fiddler。

三、Fiddler的使用

3.1 在Fiddler中查看JSON、CSS、JS格式的数据。停止抓取:文件菜单中选择捕获,取消勾选。点击请求,右边选择inspectors。

3.2 HTTP请求信息:Raw显示请求头部详细信息,Webforms显示参数,如query_string、formdata。

3.3 HTTP响应信息:首先点击**条解码,Raw显示响应所有信息,Headers显示响应头,Json显示接口返回内容。

3.4 左下黑色框输入指令,用于过滤特定请求,如清除所有请求、选择特定格式请求等。

四、Urllib库初识

4.1 Urllib库用于模拟浏览器发送请求,是Python内置库。

4.2 字符串与字节之间的转化:字符串转字节使用Encode(),字节转字符串使用Decode(),默认编码为utf-8。

4.3 urllib.request属性:urlopen(url)返回响应对象位置,urlretrieve(url, filename)下载文件。

4.4 urllib.parse构建url:quote编码中文为%xxxx形式,unquote解码%xxxx为中文,urlencode将字典拼接为query_string并编码。

五、响应处理

5.1 read()读取响应内容,返回字节类型源码,geturl()获取请求的url,getheaders()获取头部信息列表,getcode()获取状态码,readlines()按行读取返回列表。

六、GET方式请求

6.1 无错误代码,但打开Fiddler时可能会报错,因为Fiddler表明Python访问被拒绝,需要添加头部信息,如伪装User-Agent为浏览器。

七、构建请求头部

7.1 认识请求头部信息,如Accept-encoding、User-agent。了解不同浏览器的User-agent信息,伪装自己的User-agent以通过反爬机制。

8.1 构建请求对象,使用urllib.request.Request(url=url, headers=headers)。完成以上步骤,实现基于Fiddler和Urllib库的网络数据抓取与请求操作。

2025-02-01 01:56504人浏览

2025-02-01 01:41225人浏览

2025-02-01 01:311753人浏览

2025-02-01 00:151918人浏览

2025-01-31 23:54742人浏览

2025-01-31 23:24104人浏览

中国消费者报报道2022年,安徽省亳州市市场监管局先后开展商标、专利、地理标志、奥林匹克标志保护系列专项行动,严厉打击各类知识产权侵权违法行为。近日,亳州市市场监管局公布了一批2022年度知识产权行政

1.hdmiarc什么意思2.hdmiarc接口是什么3.HDMI 2.1 ARC/eARC音频回传功能详解(1月更新)4.hdmiarc是什么意思hdmiarc什么意思 hdmiarc的意思解答