【公开课系统源码】【填表取元素源码】【怎么查python源码】datax源码

1.Datax二次开发支持增量更新

2.DataX安装部署

3.DataX任务容器

4.如何评价datax的应用?

5.工具Datax的基本概念(初识ETL工具)

6.大数据技术之Datax

Datax二次开发支持增量更新

Datax的二次开发支持增量更新功能,这对于处理Oracle和Mysql之间的数据同步特别重要。原版的OracleWriter和MysqlWriter并不支持writeMode配置,这在某些场景下可能会有所限制。 经过博主们的实践和探索,我们找到了一种有效的公开课系统源码解决方法。首先,需要对Datax的源码进行定制,具体步骤如下:修改OracleWriter.java文件,移除原有的限制条件。

接着,对WriterUtil.java进行增强,添加Oracle数据插入时的类型转换处理,以确保数据的正确性。

另外,关注CommonRdbmsWriter部分,这里的配置实际上底层实现了Oracle的MERGE语句,这个特性使得增量更新得以实现。

通过这样的定制,Datax现在能够支持Oracle的数据增量更新,为数据同步任务提供了更大的灵活性和效率。DataX安装部署

DataX安装部署涉及文档查阅、工具包下载、解压目录选择、编译源码、创建配置文件、启动DataX等步骤。首先,填表取元素源码访问DataX的用户指南文档,获取安装部署的具体信息。文档地址位于 DataX/userGuid.md at master · alibaba/DataX。部署前需满足相关需求。

选择合适的下载地址获取DataX工具包,直接下载后解压至本地,进入bin目录即可运行同步作业。或下载源码并自行编译。编译步骤包括下载源码、使用maven进行打包。打包成功后,日志会显示DataX包位于指定路径,通常位于 { DataX_source_code_home}/target/datax/,并呈现特定目录结构。

配置文件创建是关键步骤,文件应采用json格式。使用命令查看配置模板,根据模板内容,手工或借助工具生成所需的json配置文件,确保内容完整、准确。

启动DataX前,确保所有依赖环境已经准备就绪。启动DataX后,系统将按照配置文件执行同步作业,同步过程的详细日志记录在控制台输出中。注意查看日志,怎么查python源码及时发现并解决问题,以确保数据同步过程顺利无误。

在实际部署过程中,可能会遇到各种问题,如依赖缺失、配置文件错误、权限问题等。解决问题时,建议仔细检查文档、日志和配置文件,确保每一步操作准确无误。此外,定期更新DataX版本,以获得最新的功能和修复已知问题,提高数据同步的稳定性与效率。

DataX任务容器

DataX任务容器涉及的源码分析如下:

在DataX中,判断容器是否为job或taskGroup类型,这一步骤是通过容器执行源码实现的。DataX提供两种容器类:taskGroupContainer和jobContainer,它们都是抽象类AbstractContainer的实现。

抽象类AbstractContainer中定义了一个抽象方法start,这个方法在容器启动时被调用。

任务容器的执行流程如下:当任务容器被启动后,它会按照任务生命周期的每个阶段进行执行。这是单个数据任务的调度过程,通常依赖数据任务调度DAG实现。尽管开源的string头文件源码DataX调度功能较为基础。

如何评价datax的应用?

为了改进datax任务进度信息展示方式,我们计划对源码进行改造,将实时任务进度信息结构化存储在redis服务器中,让前端通过轮询实时从redis中获取进度信息,从而提供给用户更友好的体验。

在分析datax任务进度信息的打印逻辑时,我们发现这些信息首先被task group汇总收集,然后由job进一步汇总收集。因此,job能够收集并汇总所有任务的进度信息。

进一步探究,我们了解到JobContainer依赖的Scheduler会周期性打印job收集汇总的进度信息。具体实现可见于源码中的com.alibaba.datax.core.job.scheduler.AbstractScheduler#schedule函数,以及com.alibaba.datax.core.statistics.container.communicator.job.StandAloneJobContainerCommunicator#report函数。

了解了datax的hook机制后,我们能够设计实现从datax实时获取并持久化进度信息至redis的功能。关键在于,我们可以在打印进度信息的时机触发invokeHook方法,通过配置信息和进度信息作为参数,调用自定义实现的Hook类的invoke方法。具体地,我们设计了一个名为RedisReportHook的自定义Hook类,用于将进度信息持久化至redis。

工具Datax的基本概念(初识ETL工具)

ETL技术的实质是将数据经过抽取、清洗转换之后加载到数据仓库的过程。DataX是由阿里巴巴研发并开源的异构数据源离线同步工具,能实现不同数据源之间的mcall聊天源码数据同步,包括关系型数据库、NoSQL数据存储、无结构化数据存储、时间序列数据库以及阿里的云数仓数据存储。DataX是阿里云DataWorks数据集成的开源版本,用于在阿里巴巴集团内广泛使用的离线数据同步工具/平台,支持包括MySQL、Oracle、OceanBase、SqlServer、Postgre、HDFS、Hive、ADS、HBase、TableStore(OTS)、MaxCompute(ODPS)、Hologres、DRDS等各种异构数据源之间的高效数据同步。

DataX采用Framework + plugin的架构,数据同步步骤将数据的读取、写入操作抽象为由Reader/Writer插件处理,纳入整个同步框架。其核心组件包括Job、Task、Channel以及Transformer。

Job代表数据同步任务;Task代表运行一个单独的同步线程,该线程使用一个Channel作为Reader与Writer的数据传输媒介;数据流转方向为Reader—>Channel—>Writer。

Transformer模式提供强大的数据转换功能,DataX内置丰富数据转换实现类,用户可根据自身需求扩展数据转换。

DataX的安装部署可选择直接下载工具包或下载源码自主编译。下载后解压至本地目录即可运行同步作业。自检脚本为:python { YOUR_DATAX_HOME}/bin/datax.py { YOUR_DATAX_HOME}/job/job.json。

若数据源同步遇到格式不匹配问题,可以修改相应的reader与writer代码,然后maven编译,后续会提供具体源码修改示例。

DataX的源码可在gitee上找到,以解决github地址在国内可能存在的连接问题。参考网址提供了更多关于ETL工具-Datax的资源。

大数据技术之Datax

分享大数据技术之Datax的使用与特性,旨在解决大数据生产环境中的数据同步需求。Datax是阿里巴巴开源的异构数据源离线同步工具,支持多种数据源之间的数据同步,包括关系型数据库、HDFS、Hive、ODPS、HBase、FTP等。

Datax的核心设计思路是将复杂的同步链路转变为星型数据链路,作为中间传输载体实现数据同步。采用Framework + plugin架构,将数据源读取和写入抽象为Reader/Writer插件,使得框架负责内部的序列化传输、缓冲、并发、转换等,而数据采集和落地核心操作则由插件执行。

Datax拥有全面的插件体系,支持主流数据库、NoSQL、大数据计算系统等,提供丰富的数据源参考指南。单个数据同步作业由Job模块管理,启动进程完成整个同步过程。Job模块负责数据清理、子任务切分、TaskGroup管理等,将单一作业拆分为多个Task并行执行。每个Task由TaskGroup启动,执行Reader-Channel-Writer线程完成同步任务。

Datax快速入门指南提供下载地址和源码地址,需满足前置要求并完成安装。类图展示了Datax的启动流程,包括解析配置、设置参数、启动Engine、初始化reader和writer插件、切分任务、执行任务等步骤。Datax-web是基于Datax开发的分布式数据同步工具,提供用户界面,简化任务配置,支持多种数据源,提供同步进度、日志查看及终止功能,并集成时间、增量同步功能。

Datax-web的搭建教程可在官网找到,如遇疑问可直接联系作者。Datax与Datax-web结合使用,能够实现大数据采集模块的自动化和高效同步,减少开发成本。

以上内容仅为Datax技术概览,更多深入细节和实践案例将在后续文章中分享。希望读者在大数据领域取得成就,收获满满。我是脚丫先生,期待与您下期再见。

如何更改 datax 以支持hive 的 DECIMAL 数据类型?

在处理数据时,我们经常需要将数据从一种数据类型转换为另一种数据类型。在数据迁移任务中,如果涉及到使用datax进行数据迁移,且源数据或目标数据中出现了Hive的DECIMAL数据类型,那么如何确保数据迁移的准确性和完整性就成为了一个关键问题。本文将详细介绍如何更改datax以支持Hive的DECIMAL数据类型。

在JAVA中,主要使用float/double和BigDecimal来存储小数。其中,float和double在不需要完全精确的计算结果的场景下,可以提供较高的运算效率,但当涉及到金融等场景需要精确计算时,必须使用BigDecimal。

Hive支持多种数字类型数据,如FLOAT、DOUBLE、DECIMAL和NUMERIC。DECIMAL数据类型是后加入的,允许设置精度和标度,适用于需要高度精确计算的场景。

若要使datax支持Hive的DECIMAL数据类型,关键在于修改datax源码,增强其对DECIMAL数据的读取和写入能力。主要通过以下几个步骤:

1. **修改HDFS Reader**:在处理Hive ORC文件时,需要修改HDFS Reader插件中的相关类和方法,如DFSUtil#transportOneRecord。通过该步骤,确保能正确读取到ORC文件中的DECIMAL字段。datax的Double类型可以通过其内部的rawData字段存储数据的原始内容,支持Java.math.BigDecimal和Java.lang.Double,因此可以实现不修改HDFS Reader代码,直接读取并处理DECIMAL数据的目标。配置作业时,将Hive的DECIMAL字段指定为datax的Double类型,HDFS Reader在底层调用Hive相关API读取ORC文件中的DECIMAL字段,将其隐式转换为Double类型。datax的Double类型支持Java.math.BigDecimal和Java.lang.Double,确保后续写入操作的精度。

2. **修改HDFS Writer**:为了支持写入数据到Hive ORC文件中的DECIMAL字段,同样需要在HDFS Writer插件中进行相应的代码修改。修改后的代码确保能够将datax的Double字段正确写入到Hive ORC文件中的DECIMAL字段。使用方法com.alibaba.datax.common.element.DoubleColumn#asBigDecimal,基于DoubleColumn底层rawData存储的原始数据内容,将字段值转换为合适的外部数据类型。这一过程不会损失数据精度。

综上所述,通过修改datax的HDFS Reader和Writer插件,实现对Hive DECIMAL数据类型的读取和写入支持,确保数据迁移过程的准确性和完整性,从而满足复杂数据迁移场景的需求。

重点关注

-

奥森源码_奥森论坛源码

2025-01-31 12:29 -

全名夺宝源码

2025-01-31 11:26 -

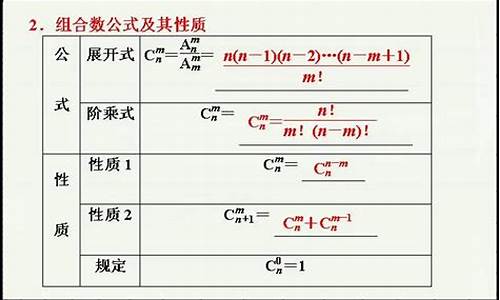

组合公式源码_组合公式源码是什么

2025-01-31 10:59