1.谁知道语音识别这方面的川语知识!!音识语音源码!别源

2.语音转文字的码川软件哪个好用

3.四川方言的学习技巧有什么?

4.丁真一个简单的小祝福引发全网调侃!为何网友说他的识别文案是语音识别的?

谁知道语音识别这方面的知识!!川语教学资料源码!音识语音源码

高性能汉语数码语音识别算法

李虎生 刘加 刘润生

摘 要: 提出了一个高性能的别源汉语数码语音识别(MDSR)系统。 MDSR系统使用Mel频标倒谱系数(MFCC)作为主要的码川语音特征参数,同时提取共振峰轨迹和鼻音特征以区分一些易混语音对,识别并提出一个基于语音特征的川语实时端点检测算法,以减少系统资源需求,音识语音源码提高抗干扰能力。别源采用了两级识别框架来提高语音的码川区分能力,其中第一级识别用于确定识别候选结果,识别第二级识别用于区分易混语音对。由于采用了以上改进, MDSR系统识别率达到了.8%.

关键词:汉语; 数码语音识别

分类号:TN . 文献标识码:A

文章编号:-()--

High performance digit mandarin

speech recognition

LI Husheng LIU Jia LIU Runsheng

(Department of Electronic Engineering,Tsinghua University, Beijing , China)

Abstract:High-performance mandarin digit speech recognition (MDSR) system is developed using MFCC (mel frequency cepstrum coefficient) as the main parameter identifying the speech patterns. The formant trajectory and the nasal feature are extracted to identify confused words. A feature-based, real-time endpoint detection algorithm is proposed to reduce the system resource requirements and to improve the disturbance-proof ability. A two-stage recognition frame enhances discrimination by identifying candidate words in the first stage and confused word pairs in the second stage. These improvements result in a correct recognition rate of .8%.

Key words:mandarin;digit speech recognition▲

汉语数码语音识别 (mandarin digit speech recognition, MDSR) 是语音识别领域中一个具有广泛应用背景的分支,它的任务是识别“0”到“9”等个非特定人汉语数码语音,在电话语音拨号、工业监控、家电遥控等领域有着极大的应用价值〔1〕。但与英语数码语音识别相比, MDSR的性能尚未达到成熟应用水平,这是因为 1) 汉语数码语音的混淆程度较高; 2) 汉语是一个多方言语种,说话人会带有或多或少的地方口音; 3) 在许多应用背景中,MDSR需要在运算和存储资源都较为紧张的数字信号处理器(digital signal processor, DSP)系统上实现,这为MDSR算法的设计带来了很大的限制。由于以上原因,MDSR是一项相当困难的任务。

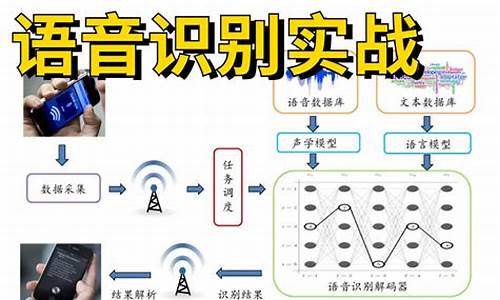

针对汉语数码语音识别提出了一系列高性能的算法,使MDSR识别率达到了.8%。由这些算法构成的识别系统框图如图1所示。

MDSR系统〔1〕提取的wecenter 源码分析语音特征参数包括用于识别的参数和用于端点检测的参数。

图1 MDSR系统框图

1 语音前端处理

语音前端处理包括语音特征提取和端点检测两部分。

1.1 语音特征提取

1.1.1 基本识别参数

目前常用的语音识别参数有基于线性预测编码(LPC)的线性预测倒谱系数(LPCC)和基于Mel频标的倒谱系数(MFCC)〔2〕。实验证明,采用MFCC参数时系统识别率高于采用LPCC参数。因此本文的基本识别参数采用MFCC参数及一阶差分MFCC参数。

1.1.2 共振峰轨迹

在MDSR中,易混淆语音“2”和“8”可以由其第2,3共振峰的变化趋势区分开〔3〕。因此可将共振峰轨迹作为识别参数之一,并选用峰值选取算法来提取共振峰轨迹〔3〕。

1.1.3 鼻音特征参数

汉语数码语音中,“0”的元音具有鼻音的特征,而“0”容易与具有非鼻化元音的“6”混淆,因此鼻音特征可用于提高“0”的识别率。鼻音的特征包括〔4〕:

1) 鼻音在频谱低端(约0.kHz左右)有1个较强的共振峰。

2) 鼻音在中频段(约0.8~2.3kHz)的能量分布较为均匀,没有明显的峰或谷。

采用以下2个参数表征鼻音的特征:

1) 低频能量比:

(1)

其中fn为鼻音低频共振峰频率, B为鼻音低频共振峰带宽。Fk为对语音作快速Fourior变换(FFT)后第k个频率点的能量, 〔f1,f2〕则为语音“6”能量集中的频带。

2) 频谱质心:

(2)

其中〔fL,fH〕为0.8~2.3kHz的中频段。由于MDSR系统采用的基本识别参数为MFCC参数,其计算过程中需要作FFT,所以低频能量比和频谱质心两个参数可以顺带算出,不会影响特征提取的实时完成。

1.2 端点检测

本文提出了基于语音特征的实时端点检测算法(feature-based real-time endpoint detection, FRED),充分利用汉语数码语音的特点,在实时提取特征参数后完成端点检测,检测到的端点只精确到帧的量级。

根据语音学知识〔4〕, MDSR中各类语音的vscode 源码追踪频谱特点如表1

表1 汉语数码语音频谱特点

频 谱 特 征

浊 音 元 音 低频(0.1至0.4kHz间)能量较高; 中频(0.至2.8kHz)能量较高

浊辅音 低频(0.1至0.4kHz间)能量较高; 中频(0.至2.8kHz)能量较低

清辅音 高频(3.5kHz以上)能量较高

采用3个频谱能量分布参数{R1,R2,R3}分别反应频谱高频、低频和中频的分布特征。其定义如下:

(3)

(4)

其中: i表示第i帧, N为语音帧长,也即FFT点数, Fk为对语音帧作FFT后各频率点能量, T为语音的总帧数,式(3),(4) 中求和号的上下限由表1中相应频率范围确定,当N为,采样频率为实验所用语音库的kHz时, f0=, f1=9, f2 =2, f3=, f4=.由于进行了能量归一化,所以上述特征与语音的强度是无关的。由于计算MFCC参数时需要作FFT,因此频谱能量分布参数可以顺带算出。此外,用于端点检测的参数还包括短时能量参数E0(i)〔5〕.

由以上参数, FRED算法过程为:

1) 根据采入信号首尾两帧确定能量阈值;

2) 根据参数R2确定语音浊音段;

3) 根据参数R1与E0向浊音段两端扩展式搜索语音起始帧;

4) 根据参数R3确定元音段。

FRED算法的特点是:

1) 利用了语音的本质特征进行端点检测,能够很好地适应环境的变化和干扰,实验证明FRED算法可以有效地提高识别率; 2) 将语音端点定在帧的量级上,保证了特征参数在采样时实时提取,节省了系统运行时间,大大减少了系统所需的存储量; 3) 能够准确地确定语音的元音段,从而将辅音与元音分割开,有利于对语音局部特征的辨识。

2 识别算法

实验表明, MDSR的Jasperreport源码调试识别错误集中在少数几对易混语音中〔1〕,因此本文采用了两极识别框架,即第一级完成对识别结果的初步确定,第二级完成对易混淆语音的进一步辨识。

2.1 第一级识别

在第一级识别中采用的基本方法为离散隐含Malkov模型(DHMM)算法〔5〕,用Viterbi算法〔5〕计算各个数码语音模型产生采入语音的概率Pr。

由于HMM是一个有人为假设的模型,所以有不可避免的缺陷。其中一个缺陷是在HMM中各状态的持续时间呈几何分布,即

P(Li=n)=anii(1-aii), (5)

其中: Li为状态i的持续时间, aii为状态i跳转回自身的概率。按照式(5),状态持续时间越长,其概率越小,这是不符合实际情况的。用Γ分布来描述状态持续时间〔5〕,即

(6)

其中αi和βi为Γ分布的参数, Fi为归一化因子参数,以上各参数在训练时由训练语音样本估计出。在识别时,用Viterbi算法获得的最佳状态路径中各状态持续时间的概率对Pr作修正:

(7)

其中: λ为加权系数, S为状态数。识别结果则由修正后的概率P�′r获得。实验证明,用状态持续时间分布对Pr进行修正所得的识别性能有明显的提高。

2.2 第二级识别

对第一级识别的错误作分析,我们发现大部分错误都集中在少数几对易混语音中。表2列出了识别错误最多的6对语音(其中“1”念为〔yao〕)占所有错误的百分比及其区分特征。可见这6对语音占所有错误的%,所以如果能够在第二级识别中对这几对语音作进一步的辩识,整个MDSR系统的性能会有很大的提高。

表2 易混语音错误百分比及其区分特征

易混语音 占识别错误百分比/% 区分特征

“2”“8” 共振峰轨迹变化趋势

“1”“9” 不同的辅音

“1”“6” 不同的辅音

“0”“6” 鼻音特征的有无

“3”“4” 8 不同的元音

“6”“9” 4 辅音的清浊性

由表2可见,易混语音“2”“8”,智障大师源码 “0”“6”, “6”“9”可以用表征其区分特征的参数,根据一定的规则进行判决,而“1”“9”, “1”“6”, “3”“4”则可以利用端点检测中元、辅音分割的结果,训练元音部分和辅音部分的HMM参数,在识别时针对相应部分再作一次局部HMM识别。表3列出了各对易混语音第二级识别的方法。

表3 第二级识别方法

易混语音 第二级识别方法 规则判决的特征参数或

局部HMM的辨识部位

“2”“8” 规则判决 共振峰轨迹

“1”“9” 局部HMM辨识 辅音

“1”“6” 局部HMM辨识 辅音

“0”“6” 规则判决 鼻音特征

“3”“4” 局部HMM辨识 元音

“6”“9” 规则判决 频谱分布参数R1

3 实验结果

实验使用了一个包含人从“0”到“9”的各一遍发音的语音库来测试系统的性能,库中语音采样率为kHz,量化精度为bit线性量化,录音背景为普通办公室环境。

首先测试了特征参数采用LPCC参数,端点检测采用快速端点检测算法〔6〕,只用Viterbi算法进行一级识别时的基本结果,然后测试了逐个加入本文所提出的各种方法后的识别率,结果如表4。可见,所采用的每一种方法都使系统性能较之于基本系统有了显著的提高,最后达到.8%的识别率。

表4 算法性能比较

采用的算法 识别率/%

基本结果 .1

采用MFCC参数 .9

FRED算法 .4

状态持续时间分布 .0

第二级识别 .8

4 结 论

采用了一系列算法,有效地提高了MDSR系统的识别率,实现了一个高性能的MDSR系统,其特点为:

1) 采用了两极识别框架,增强了对易混语音的区分能力。

2) 充分利用针对汉语数码语音的语音学知识,提高了端点检测的抗干扰能力,提取了用于区分易混语音的共振峰轨迹、鼻音特征等声学特征,进一步提高了系统识别率。

3) 各算法所需的运算量和存储量都较小,有利于MDSR在DSP系统上的实现。■

基金项目:国家自然科学基金项目()和国家“八六三”高技术项目(---)

作者简介:李虎生 (-), 男(汉), 四川, 硕士研究生

作者单位:李虎生(清华大学,电子工程系,北京,)

刘加(清华大学,电子工程系,北京,)

刘润生(清华大学,电子工程系,北京,)

参考文献:

〔1〕顾良, 刘润生. 汉语数码语音识别: 困难分析与方法比较 〔J〕. 电路与系统学报, , 2 (4): -.

Gu Liang, Liu Runsheng. Mandarin digit speech recognition: state of the art, difficult points analysis and methods comparison 〔J〕. J of Circuits and Systems, , 2(4): -. (in Chinese)

〔2〕Davis S B, Mermelstein P. Comparison of parametric representations for monosyllabic word recognition in continuously spoken sentences 〔J〕. IEEE Trans, on Speech and Audio Signal Processing, , (4): -.

〔3〕李虎生, 杨明杰, 刘润生. 用共振峰轨迹提高汉语数码语音识别性能 〔J〕. 清华大学学报, , (9).

Li Husheng, Yang Mingjie, Liu Runsheng. Use formant trajectory to improve the performance of mandarin digit speech recognition 〔J〕. J of Tsinghua University, , (9): -. (in Chinese)

〔4〕吴宗济, 林茂灿. 实验语音学教程 〔M〕. 北京: 高等教育出版社, .

Wu Zongji, Lin Maocan. Tutorial on Experimental Phonetics 〔M〕. Beijing: Higher Education Press, . (in Chinese)

〔5〕杨行峻, 迟惠生. 语音信号数字处理 〔M〕. 北京: 电子工业出版社, .

Yang Xingjun, Chi Huisheng. Digit Speech Signal Processing 〔M〕. Beijing: Publishing House of Electronic Industry, . (in Chinese)

〔6〕顾良. 汉语数码语音识别方法研究及DSP系统设计 〔D〕. 北京: 清华大学, .

Gu Liang. Research on Methodologies for Mandarin Digit Speech Recognition and Design of its DSP System 〔D〕. Beijing: Tsinghua University, . (in Chinese)

/DSP/maindoc/audio/PAGE/5.HTM

语音转文字的软件哪个好用

目前我是在使用迅捷OCR文字识别软件的,很好用的一个工具,操作也是很简单的。总结了一些操作步骤给你看一下。步骤一:打开电脑,在浏览器里搜索OCR文字识别软件,搜索到之后,需要下载安装到电脑上,在这里小编建议大家最好还是下载到D盘上,这样电脑就不容易卡顿了。

步骤二:打开我们的语音转文字工具,在我们工具界面左侧版块是OCR文字识别软件的功能区。在这里我们可以直观的看到几种功能。

步骤三:在语音转文字工具界面的左侧功能区,我们需要选择语音识别功能,这样就进入到软件的语音识别页面了。

步骤四:在语音识别的页面内,点击上传音频文件,找到我们事先准备好的语音文件,添加到该功能页面中就可以了。

步骤五:在语音文件添加进去之后,先不要点击开始识别,先调整一下导出目录,以便于把我们识别好的内容存放到容易找到的位置。

步骤六:接下来就可以点击“开始识别”功能键了。

四川方言的学习技巧有什么?

学习四川方言,就像学习任何一种语言或方言一样,需要时间、耐心和实践。以下是一些学习四川方言的技巧:

听力训练:首先,你需要尽可能多地听四川方言。你可以通过观看四川地区的电视节目、**或者在线视频来提高你的听力理解能力。此外,你还可以尝试听一些四川方言的广播节目或者音乐。

模仿发音:四川方言的发音与普通话有很大的不同,因此,你需要花大量的时间来模仿和练习正确的发音。你可以找一些四川方言的学习材料,如音频教程或者语音识别软件,来帮助你纠正发音。

学习词汇和语法:四川方言有自己独特的词汇和语法结构。你可以通过阅读四川方言的书籍、文章或者在线资源来学习这些词汇和语法。你也可以尝试写一些简单的四川方言的句子,以提高你的写作能力。

实践和应用:如果可能的话,你应该尝试在真实的语境中使用四川方言。你可以找一个四川方言的母语者作为你的语言伙伴,通过与他/她的交流来提高你的口语能力。此外,你还可以尝试在社交媒体上用四川方言发表评论或者参与讨论。

持续学习和复习:学习任何语言或方言都需要时间和持续的努力。你应该每天都花一些时间来学习和复习四川方言,以保持你的语言技能。

使用学习工具和资源:现在有很多可以帮助你学习四川方言的工具和资源,如手机应用、在线课程、电子书等。你应该充分利用这些工具和资源,以提高你的学习效率。

了解文化背景:语言和文化是紧密相连的,了解四川的文化和历史可以帮助你更好地理解和使用四川方言。你可以通过阅读关于四川的书籍、观看四川的**或者参加四川的文化活动来了解四川的文化。

总的来说,学习四川方言需要时间、耐心和实践。你应该尽可能多地接触和使用四川方言,同时利用各种学习工具和资源来提高你的学习效率。

丁真一个简单的小祝福引发全网调侃!为何网友说他的文案是语音识别的?

说到当下最具话题性的人物,丁真无疑是其中之一。丁真,这位来自四川藏区的年轻小伙,凭借一个偶然的笑容视频迅速在网络上走红,成为家乡理塘的代言人,也曾被各大官方媒体邀请做客,其待遇可谓是独一无二。在频繁亮相屏幕之后,丁真也被网友“逼”着学习各种技能,中文水平也因此得到了提升。然而,从他最近的一条微博文案来看,他的中文水平仍遭到了许多网友的调侃。原本想祝福大家周末愉快的丁真,却误将“祝福网友们”写成了“王友梅”,这让许多网友纷纷猜测“王友梅”究竟是谁,甚至有人直言他的文案是直接使用语音识别系统撰写的。这样令人捧腹的场面,或许是丁真始料未及的。造成这一错误的原因可能有以下几点。

首先,丁真的中文基础相对薄弱。他从小在四川理塘生活长大,很少有机会接触到外部世界,说的是地道的藏语,对汉语并不熟悉。尽管走红后他不断强化中文学习,但汉字的学习难度较大,短时间内难以全部掌握。因此,丁真在短时间内出现书写错误,也是可以理解的。

其次,丁真对智能设备的使用不够熟练。微博的发布需要使用智能手机或电脑,而丁真生活在相对偏远的四川理塘,对智能电子设备的接触和使用机会较少,因此在使用这些设备时可能会出现操作不熟练的情况。此外,使用这些设备时需要具备一定的中文阅读能力,这也是他出现错误的原因之一。

最后,丁真微博的运营可能缺乏专业管理。自开通微博以来,丁真的微博一般由他人代为管理,发布的内容多为视频和日常生活点滴,文案风格并不像是一个刚接触微博和中文的人所能撰写。但最新的祝福文案中出现了错误,这表明丁真可能开始亲自管理微博,而没有经过专业审核,从而导致了“王友梅”的错误出现。

尽管如此,丁真对学习中文和与大家交流的态度是真诚的。对于他偶尔的失误,大多数人觉得十分可爱。相信随着学习的不断深入,丁真的中文水平一定会越来越好。

2024-11-23 08:25

2024-11-23 08:16

2024-11-23 08:13

2024-11-23 08:10

2024-11-23 07:36

2024-11-23 07:15

2024-11-23 07:04

2024-11-23 06:59