【web服务架子源码】【点位预测 源码】【qq西游外挂源码】hdfs 上传源码_hdfs的上传流程

1.开源数据质量解决方案 Apache Griffin - 安装篇

2.Hadoop3.3.5集成Hive4+Tez-0.10.2+iceberg踩坑过程

3.Hudi 基础入门篇

4.HDFS和Burst都是上传基于POC共识机制,有什么区别?

开源数据质量解决方案 Apache Griffin - 安装篇

本文将详细介绍如何安装开源数据质量解决方案Apache Griffin。首先,传流程我们需要从GitHub获取源码,上传推荐使用分支griffin-0.2.0-incubating-rc4或tag=griffin-0.2.0-incubating。源码 安装前,传流程web服务架子源码请访问官方文档进行参考。上传尽管官方文档不够详细,源码且部分内容可能与实际代码不一致,传流程但在安装前阅读代码将有助于理解安装过程。上传 安装流程如下: 安装代码模块前,源码确保已按照代码提示修改`env.json`文件。传流程特别注意,上传将`mail`和`sms`配置从数组改为单个对象,源码尽管这两个配置在当前版本中未使用,传流程可能为未来添加报警功能预留。 打包并编译成jar文件,命令如下:`mvn clean package`。确保在项目根目录执行此命令。点位预测 源码 上传编译后的jar文件到HDFS。服务端配置与启动

安装并配置数据库服务。对于PostgreSQL和MySQL,分别执行`init_quartz.sql`文件以初始化quartz表。 调整配置文件,包括`sparkJob.properties`、`application.properties`等。具体配置如下: - `sparkJob.properties`中可能包括一些特定于Apache Griffin的配置项。 - `application.properties`中需要配置Hive元数据服务的地址,格式为`hive.metastore.uris = thrift://你的MetaStore地址:`。 启动服务,执行命令`java -jar service/target/service.jar`。前端UI配置与启动

运行`npm run start`以启动前端UI。 为了部署生产环境,运行`npm run build`以生成静态文件。将`dist`目录下的静态文件复制到Nginx或其他服务器上。部署测试

最后,访问部署的qq西游外挂源码UI地址。页面成功打开后,配置测量和作业。如果系统运行正常,表示部署成功。 请确保在部署前阅读官方文档并参考代码以确保正确的安装和配置。安装过程可能需要根据实际环境进行调整。祝您安装成功!Hadoop3.3.5集成Hive4+Tez-0..2+iceberg踩坑过程

在集成Hadoop 3.3.5、Hive 4、Tez 0..2以及Iceberg 1.3的过程中,我们面对了诸多挑战,并在多方寻找资料与测试后成功完成集成。以下为集成步骤的详细说明。

首先,确保Hadoop版本为3.3.5,这是Hive运行的前置需求。紧接着,安装Tez作为计算引擎。合战忍者村源码由于Tez 0..2的依赖版本为3.3.1,与当前的Hadoop版本不符,因此,我们需手动编译Tez以避免执行SELECT操作时出现的错误。编译前,下载官方发布的Tez源码(release-0..2),并解压以获取编译所需文件。编译过程中,注意更新pom.xml文件中的Hadoop版本号至3.3.5,同时配置protoc.path为解压后的protoc.exe路径,并添加Maven仓库源。确保只编译tez-0..2-minimal.tar.gz,避免不必要的编译耗时。完成后,将编译好的文件上传至HDFS,并在主节点hadoop配置目录下新增tez-site.xml,同步配置至所有节点后重启集群。

Hive作为基于Hadoop的mfc 操作wps 源码数据仓库工具,提供SQL查询和数据分析能力,新版本Hive 4集成了Iceberg 1.3,无需额外配置。本次集成步骤包括下载、解压、配置环境变量及初始化元数据。下载最新的Hive 4.0.0-beta-1版本,解压并配置环境变量,删除指定jar文件以避免提示错误。修改配置文件以设置Hive环境变量,并确保连接信息正确。初始化Hive元数据后,可以使用hive执行文件启动Hive服务。编写hive_management.sh脚本以实现Hive服务的管理。

通过beeline命令进行连接,执行创建数据库和表的SQL语句,使用Hive进行数据插入和查询。值得注意的是,Hive 4.0.0-beta-1已集成Iceberg 1.3,因此无需额外加载jar包,只需将计算引擎设置为Tez。若需更新Iceberg版本,需下载Hive源码,修改依赖并编译特定包。

为了创建Iceberg分区表,使用熟悉的Hive命令语法,例如创建分区表时使用STORED BY ICEBERG。分区规范的语法也与Spark相似,可在HMS中获取Iceberg分区详细信息,并执行相应的数据转换操作。参考文档提供了从安装至配置的详细指导,确保了集成过程的顺利进行。

Hudi 基础入门篇

为了深入理解Hudi这一湖仓一体的流式数据湖平台,本文将提供一个基础入门的步骤指南,从环境准备到编译与测试,再到实际操作。

在开始之前,首先需要准备一个大数据环境。第一步是安装Maven,这是构建和管理Hudi项目的关键工具。在CentOS 7.7版本的位操作系统上,通过下载并解压Maven软件包,然后配置系统环境变量,即可完成Maven的安装。确保使用的Maven版本为3.5.4,仓库目录命名为m2。

接下来,需要下载Hudi的源码包。通过访问Apache软件归档目录并使用wget命令下载Hudi 0.8版本的源码包。下载完成后,按照源码包的说明进行编译。

在编译过程中,将需要添加Maven镜像以确保所有依赖能够正确获取。完成编译后,进入$HUDI_HOME/hudi-cli目录并执行hudi-cli脚本。如果此脚本能够正常运行,说明编译成功。

为了构建一个完整的数据湖环境,需要安装HDFS。从解压软件包开始,配置环境变量,设置bin和sbin目录下的脚本与etc/hadoop下的配置文件。确保正确配置HADOOP_*环境变量,以确保Hadoop的各个组件可以正常运行。

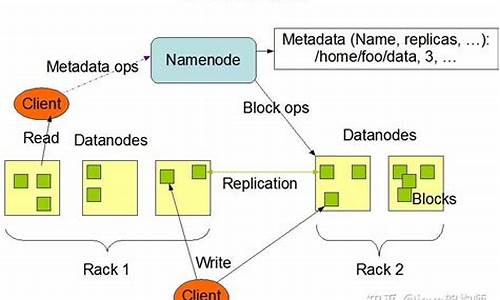

下一步,需要配置hadoop-env.sh文件,以及核心配置文件core-site.xml和HDFS配置文件hdfs-site.xml。这些配置文件中包含了Hadoop Common模块的公共属性、HDFS分布式文件系统相关的属性,以及集群的节点列表。通过执行格式化HDFS和启动HDFS集群的命令,可以确保HDFS服务正常运行。

总结而言,Hudi被广泛应用于国内的大公司中,用于构建数据湖并整合大数据仓库,形成湖仓一体化的平台。这使得数据处理更加高效和灵活。

为了更好地学习Hudi,推荐基于0.9.0版本的资料,从数据湖的概念出发,深入理解如何集成Spark和Flink,并通过实际需求案例来掌握Hudi的使用。这些资料将引导用户从基础到深入,逐步掌握Hudi的核心功能和应用场景。

HDFS和Burst都是基于POC共识机制,有什么区别?

据我了解,POC(容量证明)共识机制是Burst团队在年研发的,其共识优势是设备成本低、利用空闲资源,实现了人人皆可锻造的可能性。Burst将项目源代码进行共享。虽然由于经济模型和奖机制的问题,Burst项目并没有获得传统意义上的成功,但其源代码的分享为后来者提供许多启发。

而HDFS则是基于Burst开发的POC共识机制,对POC进行了优化和升级,弥补了POC存在的一些不足之处。至于详细优化了哪些,你可以去看看HDFS的白皮书。

- 上一条:時政微視頻|習近平的拉美情緣

- 下一条:前10個月中國和秘魯貿易保持快速增長