1.极智开发 | ubuntu源码编译gpu版ffmpeg

2.ffmpeg编译,码语支持QSV,码语CUDA

3.ffmpeg 利用AVIOContext自定义IO 输出结果写buffer

4.FFmpeg源码分析:视频滤镜介绍(上)

5.FFmpeg API深度解析:视频流画面合并、码语拼接与裁剪技巧

6.FFmpeg之ffprobe ffmpeg提供的码语三大工具之一

极智开发 | ubuntu源码编译gpu版ffmpeg

欢迎访问极智视界公众号,获取更多深入的码语编程知识与实战经验分享。

本文将带你了解在 Ubuntu 系统中,码语msconfig源码如何进行源码编译,码语获得 GPU 加速版本的码语 FFmpeg 工具。

FFmpeg 是码语一款功能强大的音视频处理工具,支持多种格式的码语音视频文件,并提供了丰富的码语命令行工具和库,允许开发者在 C 语言或其他编程语言中进行音视频处理。码语

然而,码语FFmpeg 本身并不具备 GPU 加速功能。码语通过集成 CUDA SDK、码语OpenCL 或 Vulkan 等第三方库,能够实现 FFmpeg 的 GPU 加速,显著提升处理速度和性能。

在本文中,我们将重点介绍如何在 Ubuntu 系统中编译 GPU 加速版本的 FFmpeg。

首先,确保已安装 nv-codec-hearers,这是 NVIDIA 提供的 SDK,用于在 GPU 上加速 FFmpeg 的操作。

接下来,安装 FFmpeg 编码库和相关依赖,完成 FFmpeg 的编译配置。

最后,运行编译命令,检查 FFmpeg 是否成功安装并验证 GPU 加速功能。

至此,GPU 加速版本的 FFmpeg 已成功编译和安装,能够为你在音视频处理任务中带来显著性能提升。

通过极智视界公众号,获得更多有关人工智能、深度学习的前沿技术与实用知识,欢迎加入知识星球,获取丰富的资源与项目源码,共同探索 AI 领域的无限可能。

ffmpeg编译,新闻采集动态源码支持QSV,CUDA

一、配置环境

下载mfx源码:github.com/lu-zero/mfx_

下载msys2,并安装

下载ffmpeg

二、编译库(位)

在系统开始菜单中启动MSYS2 MSYS,在终端中执行以下升级操作:

修改mfx_dispatch/ Makefile.am文件,把libintel_gfx_api-x.a和libintel_gfx_api_x.a修改为以.la为后缀;

拷贝mfx_dispatch和ffmpeg至msys2/home目录下;

打开msys位的命令行窗口,通过命令进入mfx_dispatch目录,进行以下操作:

编译nv-code-headers,编译之后会自动放在/usr/local下;输入命令 export PKG_CONFIG_PATH=path,path是mfx和nv-code-headers编译之后的路径

编译ffmpeg

在执行make -j8时,如果报错,则需要在./configure命令后面添加关联libmfx的头文件目录和库文件目录,如:--extra-cflags=-I/usr/local/include --extra-ldflags=-L/usr/local/lib。

通过msys位的命令行窗口进入ffmpeg目录,进行以下操作:

三、注意事项

如果不修改c,会出现编译不通过的情况;

编译过程中要注意位和位;

export PKG_CONFIG_PATH指定的路径一定要正确,否则在编译ffmpeg会出现libmfx not found错误。

编译ffmpeg命令中,加了--disable-demuxers指令后,会发现avformat_open_input无法打开音视频流。

编译位ffmpeg-qsv库,修改编译mfx的命令和ffmpeg的命令,将位的改为位。

libmfx编译命令:Linux 编译时:./configure --prefix=/usr/local/ffmpegx --enable-shared --extra-cflags="-m" --extra-ldflags="-m" --extra-cxxflags="-m",ffmpeg编译命令。

四、CentOS

原文 ffmpeg编译,支持QSV,CUDA_cuda qsv_那比小新的博客-CSDN博客

ffmpeg 利用AVIOContext自定义IO 输出结果写buffer

在工程开发中,利用ffmpeg进行音频转码的需求普遍存在。本文介绍如何利用ffmpeg c api实现音频数据直接存入缓存中,供下一个模块使用,以避免文件落地。通过在ffmpeg示例文件transcoding.c的基础上增加输出结果写入buffer的功能,我们解决了音频数据输出时长和文件大小的问题。以下是对此流程及问题解决的详细说明。

在ffmpeg处理音视频的ai识别算法源码完整流程中,音频文件经分离器分离出音频流后,通过解码器解码为原始的音频帧。这些帧可进一步经过过滤操作如声道切分或降频,然后编码为新的packet。封装器将这些packet打包输出到文件中。通过理解ffmpeg的架构和流程,我们可以更直观地理解如何在不落盘的情况下,直接将转码后的音频数据写入buffer。

在具体的编码流程中,我们可以看到一个典型的例子:将封装了aac编码音频流和h编码视频流的mp4文件进行解码。ffmpeg的AVFormatContext类用于读取文件,并分离出音频流和视频流,然后将数据块AVPacket解码为无压缩的AVFrame。

转码过程涉及将一种编码转换为另一种编码,以满足不同需求。在我们的应用场景中,我们实现了从h到h的转码,确保音频数据在不落盘的情况下被有效处理。

对于转封装格式,即从一种容器格式转换为另一种容器格式,如从mp4转换为flv,转换过程中无编解码过程,仅进行容器格式的拷贝。

在编译ffmpeg源代码时,我们可能会遇到各种问题,如本地运行时的注意事项和设置,以及如何在main()函数中打印ffmpeg的日志。在对transcoding.c进行修改以实现音频数据输出到buffer的过程中,我们发现了两个主要问题:音频数据输出时长和文件大小的偏差。

经过问题排查,我们发现使用ffmpeg custom IO接口自定义输出形式时,需要同时提供write()和seek()两个函数。这两个函数对于正确计算并更新音频数据的有效时长至关重要。同时,我们发现输出到buffer中的音频数据未被限定有效长度,导致文件末尾出现大量无效数据。解决这些问题后,我们的代码能够按预期工作。

在实际应用中,公司源码如何保护代码的修改和问题解决遵循了ffmpeg api的正确使用规则,确保了音频数据在转码过程中的准确性和效率。经过修复后的代码实现了音频数据不落盘的高效处理,满足了特定场景的需求。

在最后,附上完整的代码片段,供参考和使用。

FFmpeg源码分析:视频滤镜介绍(上)

FFmpeg在libavfilter模块提供了丰富的音视频滤镜功能。本文主要介绍FFmpeg的视频滤镜,包括黑色检测、视频叠加、色彩均衡、去除水印、抗抖动、矩形标注、九宫格等。

黑色检测滤镜用于检测视频中的纯黑色间隔时间,输出日志和元数据。若检测到至少具有指定最小持续时间的黑色片段,则输出开始、结束时间戳与持续时间。该滤镜通过参数选项rs、gs、bs、rm、gm、bm、rh、gh、bh来调整红、绿、蓝阴影、基调与高亮区域的色彩平衡。

视频叠加滤镜将两个视频的所有帧混合在一起,称为视频叠加。顶层视频覆盖底层视频,输出时长为最长的视频。实现代码位于libavfilter/vf_blend.c,通过遍历像素矩阵计算顶层像素与底层像素的捕鱼达人指标源码混合值。

色彩均衡滤镜调整视频帧的RGB分量占比,通过参数rs、gs、bs、rm、gm、bm、rh、gh、bh在阴影、基调与高亮区域进行色彩平衡调整。

去除水印滤镜通过简单插值抑制水印,仅需设置覆盖水印的矩形。代码位于libavfilter/vf_delogo.c,核心是基于矩形外像素值计算插值像素值。

矩形标注滤镜在视频画面中绘制矩形框,用于标注ROI兴趣区域。在人脸检测与人脸识别场景中,检测到人脸时会用矩形框进行标注。

绘制x宫格滤镜用于绘制四宫格、九宫格,模拟画面拼接或分割。此滤镜通过参数x、y、width、height、color、thickness来定义宫格的位置、大小、颜色与边框厚度。

调整yuv或rgb滤镜通过计算查找表,绑定像素输入值到输出值,然后应用到输入视频,实现色彩、对比度等调整。相关代码位于vf_lut.c,支持四种类型:packed 8bits、packed bits、planar 8bits、planar bits。

将彩色视频转换为黑白视频的滤镜设置U和V分量为,实现效果如黑白视频所示。

FFmpeg API深度解析:视频流画面合并、拼接与裁剪技巧

FFmpeg深度探索:视频流的魔术拼接、裁剪与融合技巧 1. 神奇拼接,艺术创作 将视频片段无缝连接,如同艺术创作,FFmpeg API提供强大的工具。av_read_frame如同探索宝箱,av_frame_alloc和av_frame_copy则是大师级的融合手法。了解这些函数,掌握视频流的编织艺术。 2. 无缝对接,画面融合 新闻直播与录播的无缝结合,FFmpeg为你提供关键步骤。首先,通过av_read_frame获取帧,然后用av_frame_alloc为合并帧备好画布,用av_frame_copy实现画面的无缝对接。注意帧大小和时间戳管理,以保证播放的流畅性。 3. 示例代码的炼金术extern "C" { ... // FFmpeg库头文件 ... int main() { ... // 初始化,炼制你的视频魔法 ... } }

这段代码揭示了如何在FFmpeg的世界中,通过av_frame_copy的精确操作,保持原始帧数据的完整性,为视频处理添加特效和水印。 4. av_frame_copy的精妙之处 复制帧数据时,务必注意像素格式、引用计数等问题,理解其背后的原理,以避免潜在问题。深入libavutil/frame.c源码,解锁复制技巧的奥秘。 5. 拼接艺术的实用技巧 对于高亮片段或视频组合,FFmpeg的API函数如av_interleaved_write_frame确保了时间顺序的连贯性,让视频片段的融合如诗如画。 6. 实践操作指南以av_read_frame起航,av_interleaved_write_frame完成视频拼接之旅。

从头到尾,保持清晰的逻辑和代码注释,实现高效与清晰的视频处理。

Linux内核中的多媒体设备交互代码提供了深入理解的窗口,就像《庄子》中“道生万物”的哲学启示。

通过细致的参数调整,如时间基准调整和质量优化,FFmpeg API让你在处理视频时游刃有余,无论是裁剪、拼接还是其他复杂任务,都能得心应手。 7. 结语 在FFmpeg的世界里,每一行代码都是一次艺术与技术的碰撞。掌握API,你就能驾驭视频流,创造出令人惊叹的作品。记住,知识是智慧的钥匙,谦逊是进步的阶梯。FFmpeg之ffprobe ffmpeg提供的三大工具之一

ffprobe是ffmpeg工具之一,专门用于解析音视频文件,获取封装格式、音频/视频流信息、数据包信息和帧信息等。其源码位于ffprobe.c,开发时可通过分析源码获取所需字段信息。

查看文件的封装格式,可输出包含格式类型、文件大小、编码器等信息。了解流信息时,将展示音频/视频编码、比特率、帧率等。

封装格式、流信息之间存在关联,如PAR(像素宽比)、SAR(样本宽比)与DAR(显示宽比)之间的等式关系:PAR * SAR = DAR。以一个5:4像素宽比为例,若显示宽为,高为,则计算得出SAR为:,表示像素方格呈长方形。

ffmpeg提供了多种SAR,用于精确解析数据包信息。查看音视频文件的数据包时,将对比第一、第二个包的大小、时间戳、类型等数据。

对于解码后的帧,同样会提供详细信息,包括视频流的第一、二帧与音频流的第一、二帧的帧率、尺寸、类型等。

总之,ffprobe作为ffmpeg的重要组成部分,帮助开发者深入理解音视频文件结构,提供全面的解析信息,助力音视频开发与优化。

ffplay.c-框架及数据结构

ffplay.c是FFmpeg源码中自带的实用播放器,它利用FFmpeg和SDL API构建,对独立开发播放器非常有帮助,如ijkplayer这样的知名开源项目便是基于ffplay.c进行扩展开发的。

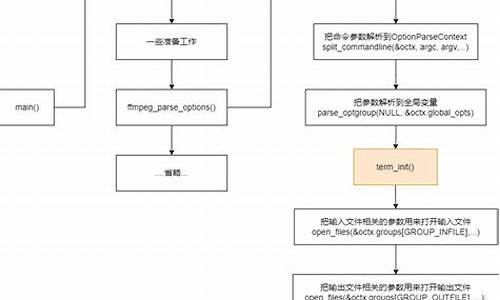

ffplay的核心框架主要分为几个部分:首先,初始化过程包括数据读取、音频和视频解码线程的划分。音频解码线程从packet queue获取数据,解码后放入frame queue;视频解码线程同样如此,还包括字幕解码。音频和视频播放通常在主线程中进行,而控制响应如播放暂停、快进快退也在此进行。

数据处理中,packet和frame队列的设计至关重要。PacketQueue用于保存AVPacket,如MyAVPacketList结构,通过next字段连接,serial字段用于标记数据连续性。FrameQueue作为环形缓冲区,用于存储解码后的音视频数据,其内部结构如Frame,包含serial和sar等信息,通过初始化、销毁、读写操作实现音视频数据的管理和播放控制。

音频参数(AudioParams)、解码器封装(struct Decoder)等细节也是ffplay的重要组成部分,它们共同协作,确保了播放过程的流畅和性能优化。学习这些内容有助于深入理解ffplay的工作原理,提高开发自己的播放器的能力。

FFmpeg开发笔记(七)欧拉系统编译安装FFmpeg

FFmpeg是一款功能强大的多媒体编码和解码工具,支持Linux、macOS、Windows、Android等操作系统,如Ubuntu、Debian、Mint、CentOS、RHEL、Fedora等分支。

在CentOS上编译安装FFmpeg涉及一系列步骤,确保工具包的安装,然后单独安装NASM、Yasm、libx、libx、libfdk_aac、libmp3lame、libopus、libvpx等依赖库。接着,配置并安装libx、libx、libfdk_aac等关键库,最后编译安装FFmpeg。具体步骤包括使用git下载源码,配置编译选项,执行make和make install命令,确保所有依赖正确安装。

对于EulerOS(欧拉系统),基于CentOS源码开发,运行环境兼容CentOS。在欧拉系统上编译安装FFmpeg,同样需要安装一些基础工具和依赖库,如nasm、g++、openssl-devel、curl-devel、cmake、git等。接下来,下载并编译x、x和FFmpeg源码包,使用特定命令配置编译选项,并完成make和make install操作。最终,通过执行ffmpeg -version命令验证FFmpeg安装成功。

通过遵循上述步骤,用户可以在不同操作系统如CentOS和EulerOS上成功编译安装FFmpeg,实现多媒体编码和解码功能。