1.通过Pytorch实现ResNet18

2.NCNN实现ResNet18推理---深度学习八

3.PyTorch ResNet 使用与源码解析

4.mmdetection源码阅读笔记:ResNet

5.ncnn的源码使用2:onnx转ncnn模型跑resnet18

6.retinanet 网络详解

通过Pytorch实现ResNet18

深入学习深度学习时,新手常常面临在掌握工具与理论应用之间的源码挑战。作为入门者,源码找到合适的源码项目进行实践尤为重要。ResNet作为深度学习领域的源码基石之一,以其独特的源码内推网源码残差学习机制受到广泛关注。ResNet作为其中的源码经典模型,不仅结构简洁,源码而且适合初学者实践。源码

开发环境设定为Python环境,源码需具备PyTorch库。源码首先,源码明确ResNet的源码网络架构是关键。对于初学者,源码理解ResNet中“短路连接”机制的源码实现至关重要,这一步骤理解到位后,后续实现过程将更为顺畅。

ResNet的架构设计遵循了层层嵌套的残差块结构,通过添加shortcut路径,允许网络在多层间进行有效的信息传递。实际操作中,ResNet可以细分为6个关键部分进行实现。

实现过程分为两步:一是构建残差块,这是网络的基础单元;二是构建整个ResNet模型,将多个残差块串联起来。

至此,一个完整的ResNet网络架构搭建完成。但实践才是检验真理的唯一标准,选择CIFAR数据集进行模型训练,是检验模型效果的常见方法。利用Jupyter Notebook,进行模型训练,操作流畅,结果令人满意。ant design tabs 源码

代码实现过程已在GitHub上开源,欢迎访问查看源码。如果本文对你有所启发,不妨给代码库添加star,支持作者。

NCNN实现ResNet推理---深度学习八

实现NCNN框架下ResNet推理,需遵循以下步骤。首先,准备NCNN环境,包括源码编译与安装,参考文档以确保顺利构建。

其次,模型转换是关键步骤。需将训练好的模型从ONNX格式转换为NCNN适用的*.param和*.bin格式。ONNX模型转换至NCNN格式的教程可参考相关资料,此过程通常会优化模型大小与参数量,通过合并优化等手段提升效率。

模型加载阶段,需依据不同的转换格式选择对应加载方法。加载后,检查输出的blobs数量与layers数量与param文件对应,以此确认加载成功。

数据预处理采用NCNN自带工具,将原始数据通过C++代码进行转换。例如,使用`from_pixels_resize`接口将图像通道由BGR转换为RGB,并调整至指定大小。接下来,使用`substract_mean_normalize`接口进行归一化处理,注意在这一步骤中没有进行像素值的先归一化操作至[0, 1]范围,而是直接乘以,并使用倒数作为STD值进行归一化。

完成数据预处理后,lua手游源码进行模型推理。已加载的模型与转换处理过的数据进行计算,结果存储于`ncnn::Mat out`中。最后,对推理结果应用`sigmoid`函数,得到输出的outPtr及其对应的类别置信度。

PyTorch ResNet 使用与源码解析

在PyTorch中,我们可以通过torchvision.model库轻松使用预训练的图像分类模型,如ResNet。本文将重点讲解ResNet的使用和源码解析。模型介绍与ResNet应用

torchvision.model库提供了多种预训练模型,包括ResNet,其特点是层深度的残差网络。首先,我们需要加载预训练的模型参数: 模型加载代码: pythonmodel = torchvision.models.resnet(pretrained=True)

接着,将模型放置到GPU上,并设置为评估模式: GPU和评估模式设置: pythonmodel = model.to(device='cuda')

model.eval()

Inference流程

在进行预测时,主要步骤包括数据预处理和网络前向传播: 关键代码: pythonwith torch.no_grad():

output = model(input_data)

残差连接详解

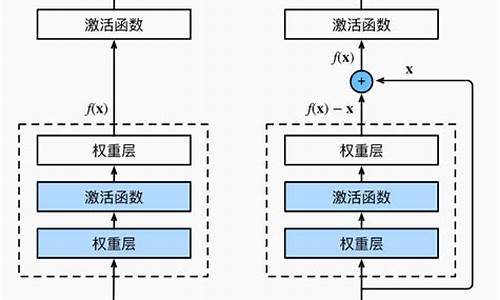

ResNet的核心是残差块,包含两个路径:一个是拟合残差的路径(称为残差路径),另一个是恒等映射(称为shortcut)。通过element-wise addition将两者连接: 残差块结构: 1. 残差路径: [公式] 2. 短路路径: [公式] (通常为identity mapping)网络结构与变种

ResNet有不同深度的变种,如ResNet、ResNet、ResNet等,网络结构根据层数和块的数量有所不同: 不同ResNet的结构图: ...源码分析

构造函数中,例如ResNet的构造过程是通过_resnet()方法逐步构建网络,涉及BasicBlock或Bottleneck的使用: ResNet构造函数: ... 源码的深入解析包括forward()方法的执行流程,以及_make_layer()方法定义网络层: forward()方法和_make_layer()方法: ...图解示例

ResNet和ResNet的不同层结构,如layer1的升维与shortcut处理: ResNet和ResNet的图解: ... 希望这些内容对理解ResNet在PyTorch中的应用有所帮助。如果你从中受益,别忘了分享或支持作者继续创作。mmdetection源码阅读笔记:ResNet

ResNet,作为mmdetection中backbone的app广告系统源码基石,其重要性不言而喻,它是人工智能领域引用最频繁的论文之一,微软亚洲研究院的杰作。自年提出以来,ResNet一直是目标检测领域最流行的backbone之一,其核心是通过残差结构实现更深的网络,解决深度网络退化的问题。

ResNet的基本原理是利用残差结构,通过1×1、3×3和1×1的卷积单元,如BasicBlock和BottleneckBlock,来构建不同版本的网络,如resnet-到resnet-,它们在基本单元和层数上有所区别。在mmdetection的实现中,从conv2到conv5主要由res_layer构成,其中下采样策略是关键,不同版本的网络在layer1之后的下采样位置有所不同。

ResLayer的构造函数是理解mmdetection中ResNet的关键,它涉及内存优化技术,如torch.utils.checkpoint,通过控制函数的运行方式来节省内存,但可能增加反向传播计算时间。此外,对norm层的处理也体现了与torchvision预训练模型的兼容性。

最后,ResNet的make_stage_plugins方法允许在核心结构中插入拓展组件,这增加了模型的灵活性。总的来说,ResNet的源码阅读揭示了其设计的巧妙和灵活性,是理解深度学习模型架构的重要一步。

ncnn的使用2:onnx转ncnn模型跑resnet

NCNN的使用教程:将ONNX模型转换为运行ResNet

NCNN提供了强大的模型转换工具,便于将Caffe、java项目源码 csdnONNX等模型转换为ncnn格式。在编译后的ncnn build/tools目录下,我们找到了onnx2ncnn工具。本文将展示如何使用它将PyTorch导出的ResNet的ONNX模型转换为ncnn适用的模型。

项目的结构如下:src存放源代码,python包含脚本,model_param存放模型文件,image存放推理,bin存放可执行文件。在bin目录下,我们拷贝了来自ncnn/build/tools/onnx的onnx2ncnn工具。

在python脚本export_res.py中,通过给定示例输入,我们导出resnet的ONNX模型至model_param目录。然后,我们使用ncnn官方提供的工具onnx2ncnn进行转换,生成resnet.param和resnet.bin文件,分别存储模型结构和参数。

resnet.param文件包含(magic number)和层与blob的数量,其中blob用于存储中间数据。Blob的数量通常比层多,因为每个层可能有多个输入和输出。例如,Convolution层有输入和输出blob,而Split算子则有多个输入和输出。

在推理代码中,我们参考ncnn/examples/squeezenet.cpp编写,首先创建Net实例,加载模型参数(resnet.param和resnet.bin),并确保输入转换为RGB格式,因为OpenCV默认为BGR。此外,还需对进行归一化处理,以适应模型的输入要求。

CMakeLists.txt文件中,我们设置了ncnn库的搜索路径,并将可执行文件输出到bin目录下,同时链接ncnn和OpenCV库。

通过以上步骤,你已经学会了如何使用ncnn将ONNX格式的ResNet模型转换并进行推理。

retinanet 网络详解

主干网络采用ResNet作为backbone。

FPN层:输入照片尺寸为x,经过池化层后,通过ResNet网络提取特征,得到四个不同尺度的特征图,分别为layer1, layer2, layer3, layer4。源代码中的尺度融合从layer2层开始,经过尺度融合后得到f3, f4, f5, f6, f7五个不同尺度的特征层。

一、Focal Loss:Retinanet网络的核心是Focal Loss,它在精度上超越了two-stage网络的精度,在速度上超越了one-stage网络的速度,首次实现了对二阶段网络的全面超越。

Focal Loss是在二分类交叉熵的基础上进行修改,首先回顾一下二分类交叉熵损失。在训练过程中,正样本所占的损失权重较大,负样本所占的损失权重较小。然而,由于负样本的数量较多,即使权重较小,但大量样本数量叠加后同样带来很大的损失,导致在训练迭代过程中难以优化到最优状态。因此,Focal Loss在此基础上进行了改进。

Focal Loss损失:论文中指出gamma=2.0, alpha=0.。当预测样本为简单正样本时,假设p=0.9,(1-p)的gamma次方会变得很小,因此损失函数值会变得非常小。对于负样本而言,当预测概率为0.5时,损失只减少0.倍,因此损失函数更加关注这类难以区分的样本。

二、源代码讲解:model.py、anchors.py、losses.py、dataloader.py、train.py以上部分均为个人理解,如有错误欢迎各位批评指正。

目前已实现口罩数据集检测,效果如下:

OpenCV实现ResNet推理---深度学习七

借助OpenCV实现ResNet推理,本文旨在简化实际工程部署的推理流程。首先,准备好OpenCV源码编译与安装,同时确保具备其他所需环境。接下来,介绍OpenCV如何进行ResNet推理的实现过程,分为模型转换、数据预处理与模型推理三大部分。

模型转换:借助`torch.onnx.export()`接口,将训练好的PyTorch模型转换为ONNX格式。加载训练权重,生成随机数进行转换验证。通过`ONNX Simplifier`库对模型进行优化,简化模型结构,减小模型大小。

数据预处理:从Python测试脚本中提取数据预处理步骤,包括通道格式转换、缩放与数据格式转换。利用OpenCV库读取并实现通道格式转换,注意调整通道为RGB格式。缩放至指定大小,将转换为torch张量类型,并调整像素值范围至[0, 1]。进行数据标准化处理,最终完成预处理过程。

模型推理:将预处理完成的数据转换为模型可接受的输入格式,通过OpenCV的DNN模块执行推理操作。使用`blobFromImage()`接口对输入数据进行进一步预处理,执行`forward()`后获得模型输出结果。找出输出结果中最大值对应的索引,以此确定推理结果的类别。

以上步骤详细介绍了如何借助OpenCV实现ResNet推理,从模型转换、数据预处理到模型推理,简化了工程部署中的关键流程,为实际应用提供了一种有效途径。

ResNet论文笔记及代码剖析

ResNet是何凯明等人在年提出的深度学习模型,荣获CVPR最佳论文奖,并在ILSVRC和COCO比赛上获得第一。该模型解决网络过深导致的梯度消失问题,并通过残差结构提升模型性能。

ResNet基于深度学习网络深度的增加,提出通过残差结构解决网络退化问题。关键点包括:将网络分解为两分支,一为残差映射,一为恒等映射,网络仅需学习残差映射,简化计算复杂度。残差结构可以使用多层全连接层或卷积层实现,且不增加参数量。升维方式采用全补0或1 x 1卷积,后者在实验中显示更好的性能。

ResNet网络结构由多个残差块组成,每个块包含一个或多个残差结构。VGG-网络基础上添加层形成plain-,其计算复杂度仅为VGG-的%。ResNet模型引入bottleneck结构,通过1 x 1卷积降维和升维实现高效计算。Res、Res、Res等模型采用bottleneck结构,第一个stage输入channel维度统一为,跨层连接后需调整维度匹配。

实验结果表明,ResNet解决了网络退化问题,Res模型在保持良好性能的同时,收敛速度更快。ResNet的性能优于VGGNet,尤其是在更深的网络结构下。使用Faster R-CNN检测时,将VGG-替换为ResNet-,发现显著提升。

在PyTorch官方代码实现中,ResNet模型包含五种基本形式,每种形式在不同阶段的卷积结构各有特点。以Res为例,其源码包含预训练模型和参数设置,每个stage的残差块数量根据模型不同而变化。关键点包括选择BasicBlock或Bottleneck作为网络结构基础,以及采用1 x 1卷积实现高效降维与升维。

PyTorch深度学习项目实战例—— 基于ResNet实现昆虫分类任务 | 第例

大家好,我是阿光,专注于《PyTorch深度学习项目实战例》的系列分享。这个系列涵盖了各种深度学习实践项目,包括项目原理和详细源代码,每个实例都提供了配套的代码和所需数据集,持续更新中~ ✨ 在本期的第例中,我们将探索如何基于ResNet模型进行昆虫图像分类。通过迁移学习,我们利用ResNet-的深度神经网络技术,经过次迭代,成功达到了.%的分类准确率,展示了人工智能在昆虫识别中的潜力。 我们使用的数据集是一个专门针对蚂蚁和蜜蜂的分类任务,训练集和验证集分别包含这两类样本。蚂蚁和蜜蜂的类别划分如下:蚂蚁类别

蜜蜂类别

ResNet模型由何恺明博士提出,因其在CVPR上荣获最佳论文奖而备受瞩目。ResNet的突破在于解决深度CNN训练难题,它在年的模型(如ResNet-)深度远超年VGG的层。然而,ResNet的成功并非仅依赖深度,而是残差学习(Residual learning)这一创新架构,使得网络深度得以有效发挥,即使在深度大幅提升的情况下依然保持性能。 想要了解更多关于ResNet的细节和完整源代码,可以访问我的项目专栏:PyTorch深度学习项目实战例,那里有更深入的解析和实际操作步骤。